大家好,我是R哥。

虽然 DeepSeek 官方提供了可视化聊天界面,但稳定性实在太差了,动不动就服务繁忙,根本没办法正常使用。另外,对于一些对数据隐私、实时性能要求较高的场景,本地部署也是不可避免的选择。

那么,如何本地部署 DeepSeek R1 的模型?

本篇,开干!

相关阅读:

如何部署 DeepSeek-R1?

推荐使用 ollama 部署,方便快捷。

打开 ollama 官网,下载并安装 ollama 应用程序:

常用命令:

| 命令 | 说明 |

|---|---|

serve |

启动 Ollama |

create |

创建模型 |

show |

显示模型信息 |

run |

运行模型 |

stop |

停止正在运行的模型 |

pull |

拉取模型 |

push |

推送模型 |

list |

列出所有模型 |

ps |

列出正在运行的模型 |

cp |

复制模型 |

rm |

删除模型 |

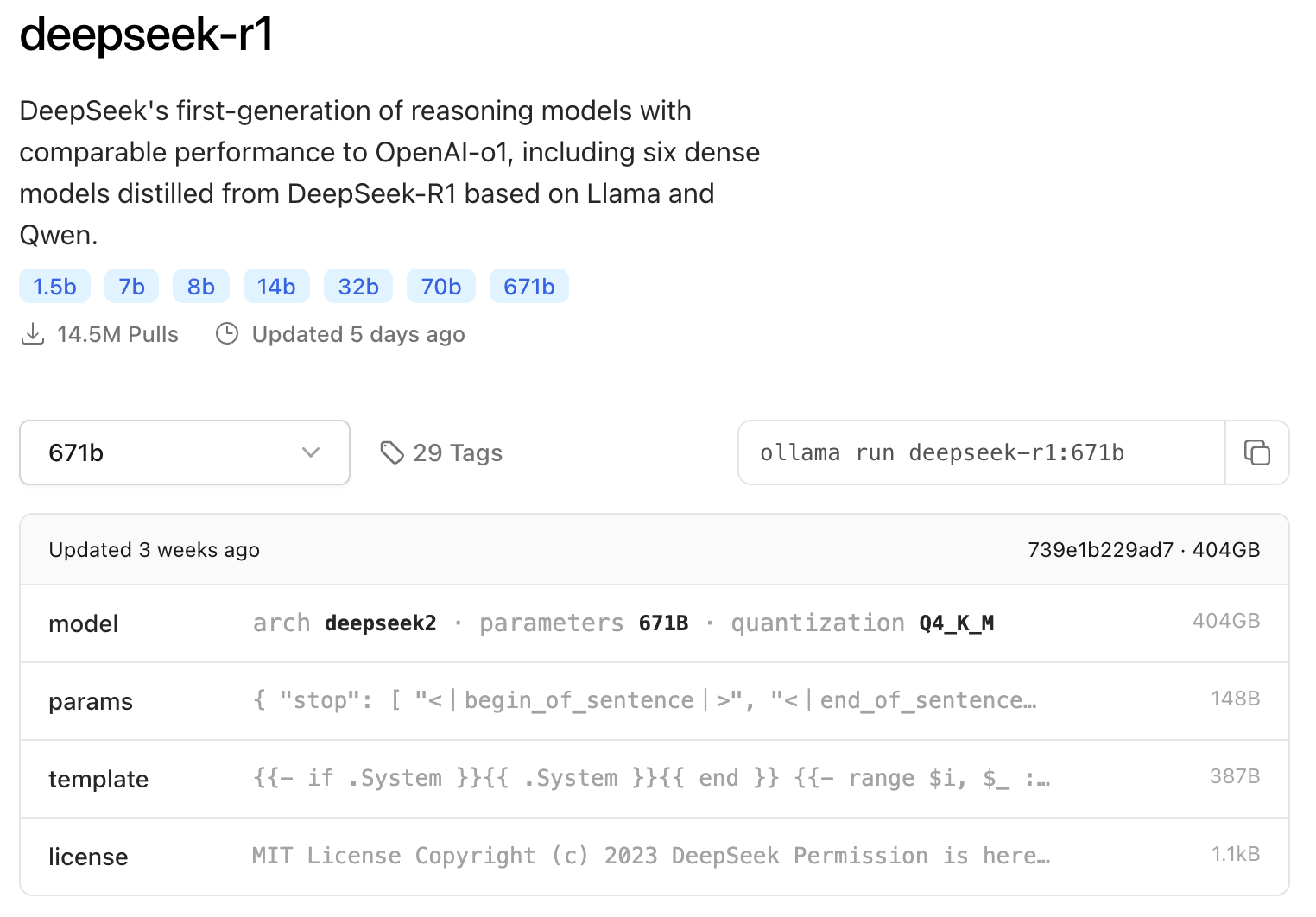

在 ollama 官网找到 deepseek-r1 模型:

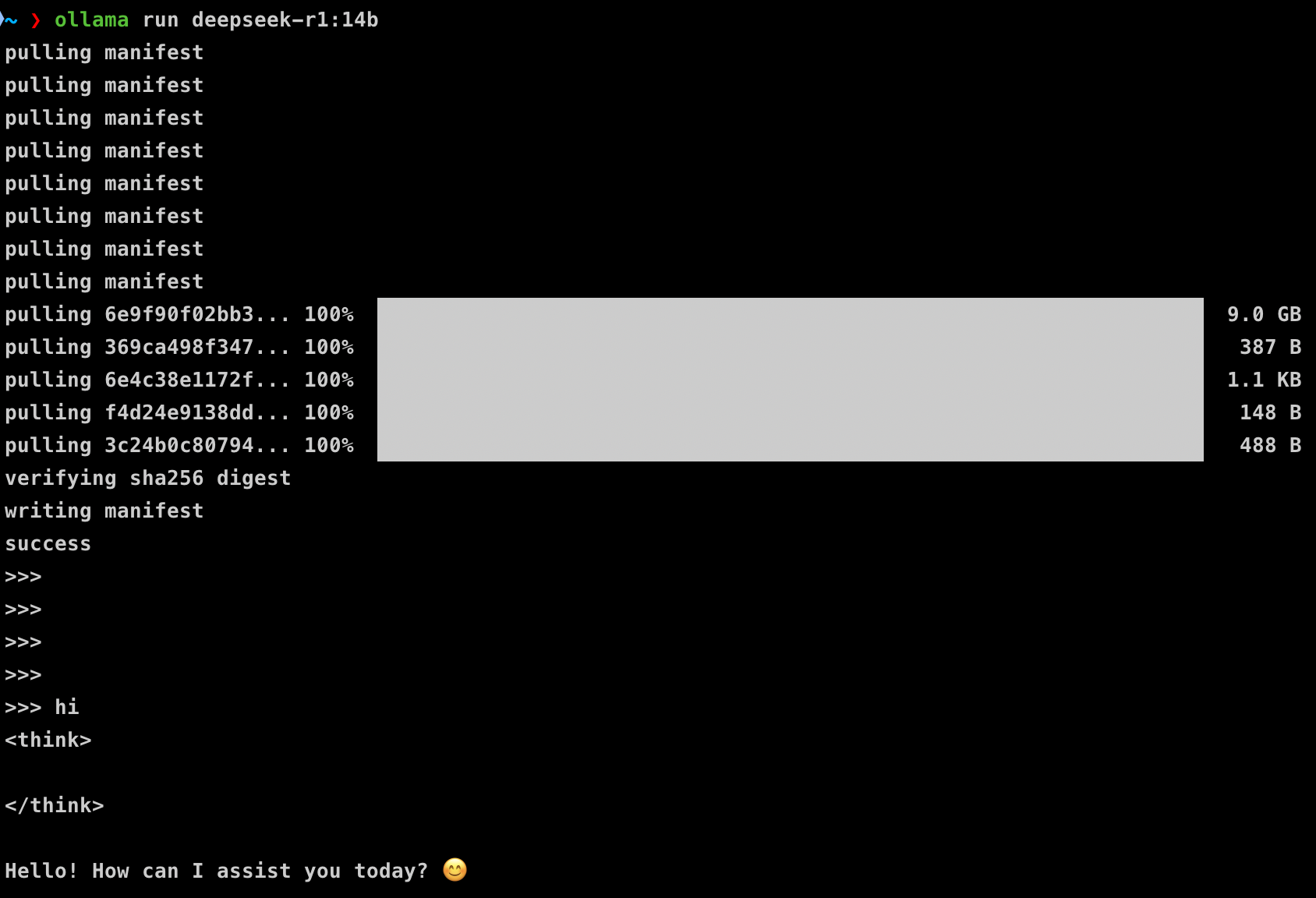

如部署 14b 蒸馏版,先下载 ollama 后,再运行以下命令:

ollama run deepseek-r1:14b

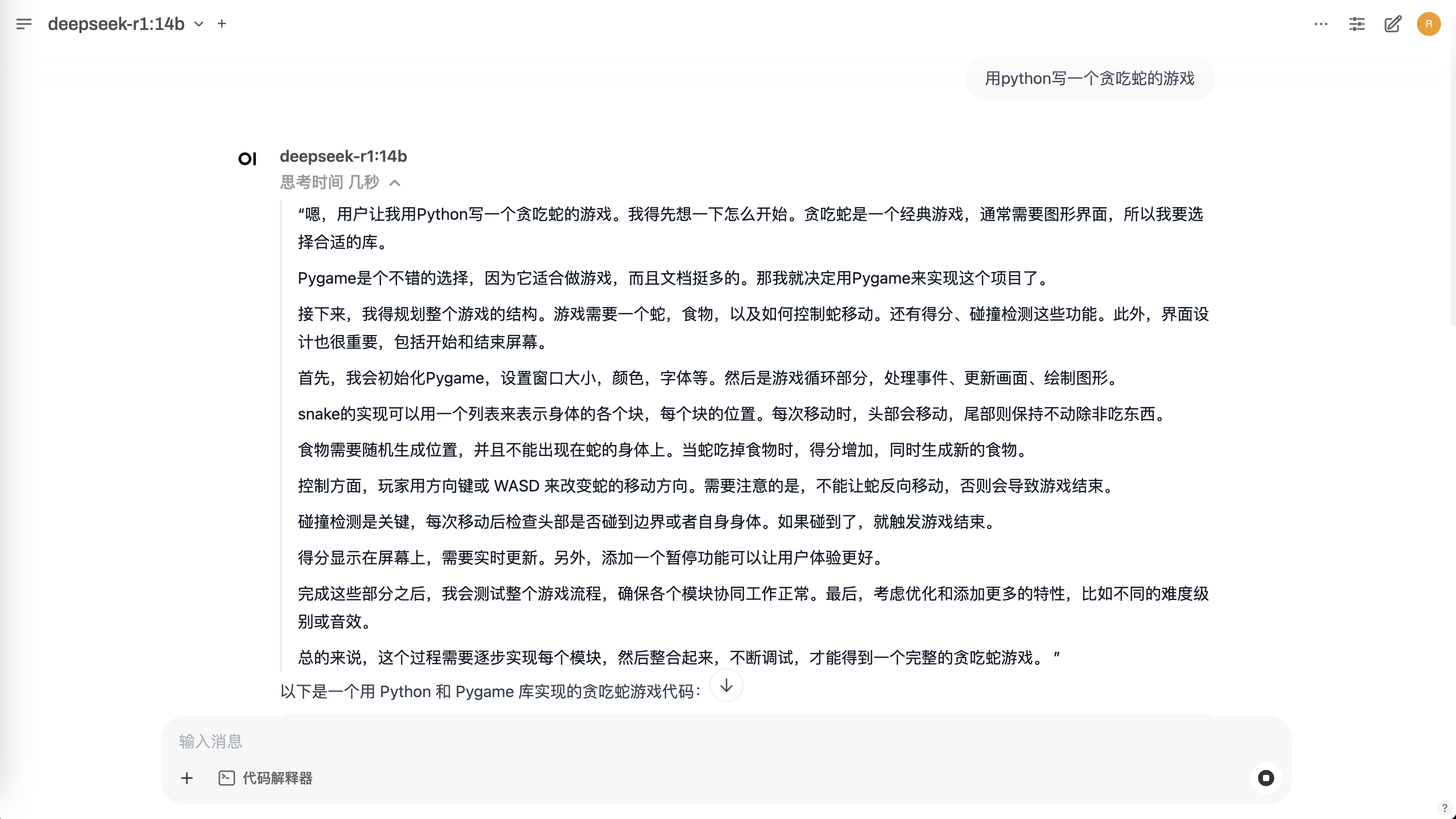

部署在本地运行就是快,和它聊天哗哗出结果。

Open WebUI

在控制台和大模型圣诞不是很方便,推荐使用 open-webui,可以更方便、友好地和大模型互动。

open-webui 是一个开源的 AI Web 用户界面项目,它提供一个友好的用户界面,方便用户通过 Web 浏览器与 AI 模型进行交互,支持运行和管理各种深度学习模型,比如 GPT、LLaMA、Bloom 等。

官网和开源地址:

安装 Open WebUI:

pip install open-webui

运行 Open WebUI:

open-webui serve [–port XXXX]

默认为 8080 端口,可以通过 --port 来指定自定义端口。

访问 Open WebUI:

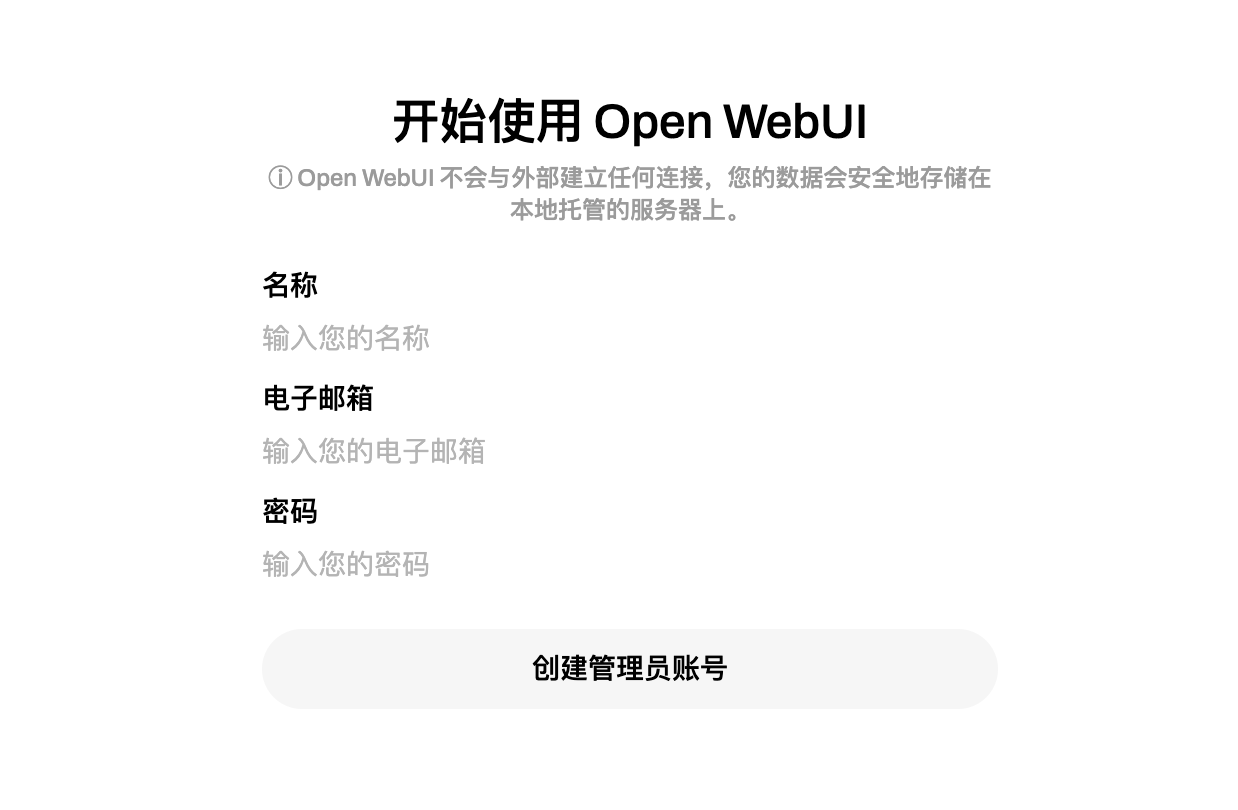

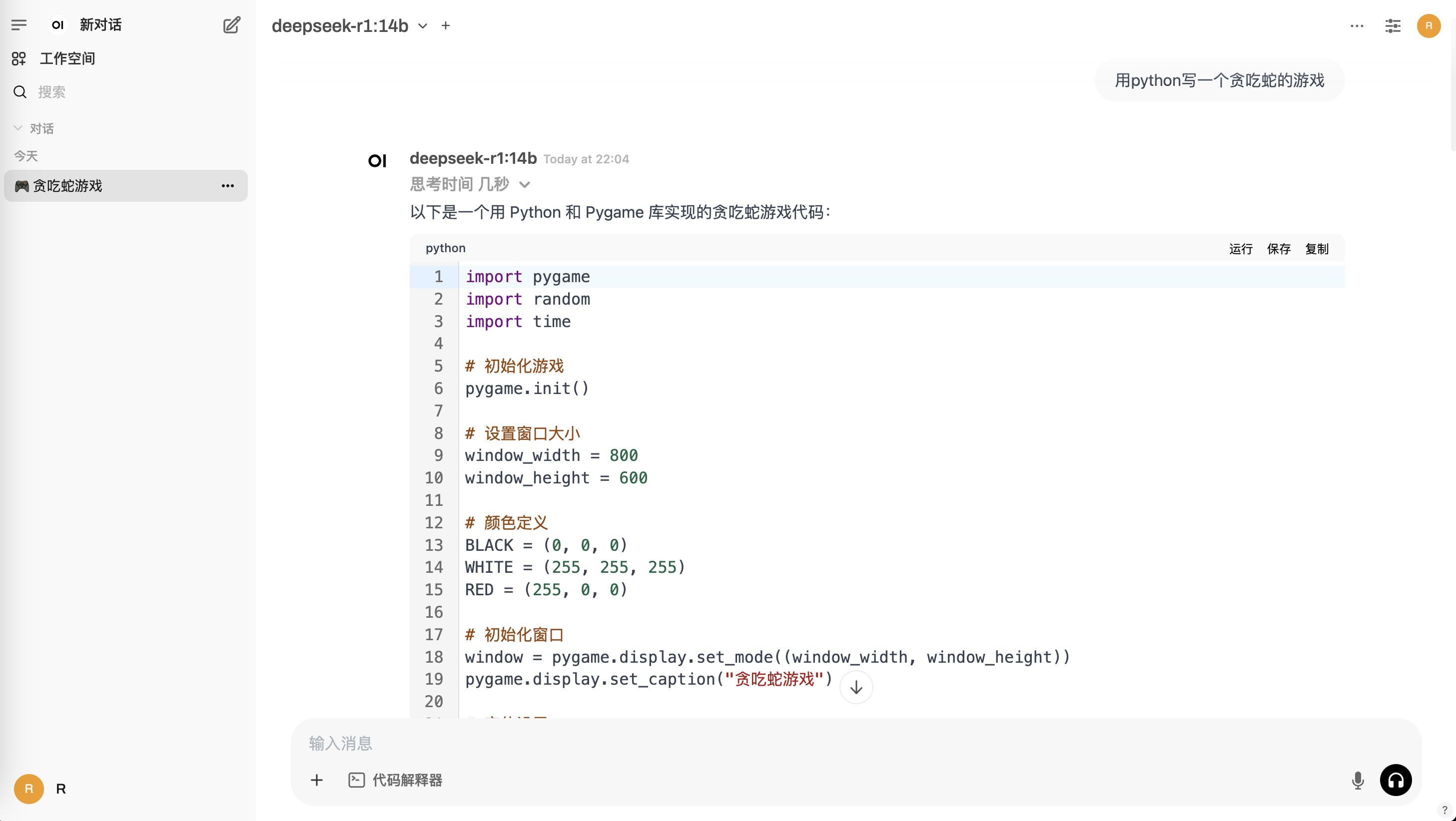

点击开始使用,首次进入需要创建一个管理员账号:

创建管理员账号后,就进入聊天界面了,左上角可以选择 Ollama 正在运行的模型:

这样一个 DeepSeek 本地部署 + 可视化界面搭建就完成了,你还可以把它部署到云上,然后绑定自己的域名,这样其他设备也能访问本地部署版的 DeepSeek 了。

未完待续,公众号持续分享「DeepSeek」及 AI 实战干货,关注「AI技术宅」公众号和我一起学 AI。

最后,如果你还没用过 DeepSeek,清华大学出的《DeepSeek 从入门到精通》推荐你好好看看吧,质量非常高,从原理到应用实践,写得非常好。

声明:本站所有文章,如无特殊说明或标注,均为本站原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。