大家好,我是R哥。

前些天给大家分享了如何在 IDEA 中使用 Claude Code 和 Codex:

如果想接入更多的 AI 编程助手,或者想接入第三方 AI API、以及自己的本地模型,IDEA 也提供了非常方便的接入方式。

接入 AI 编程助手

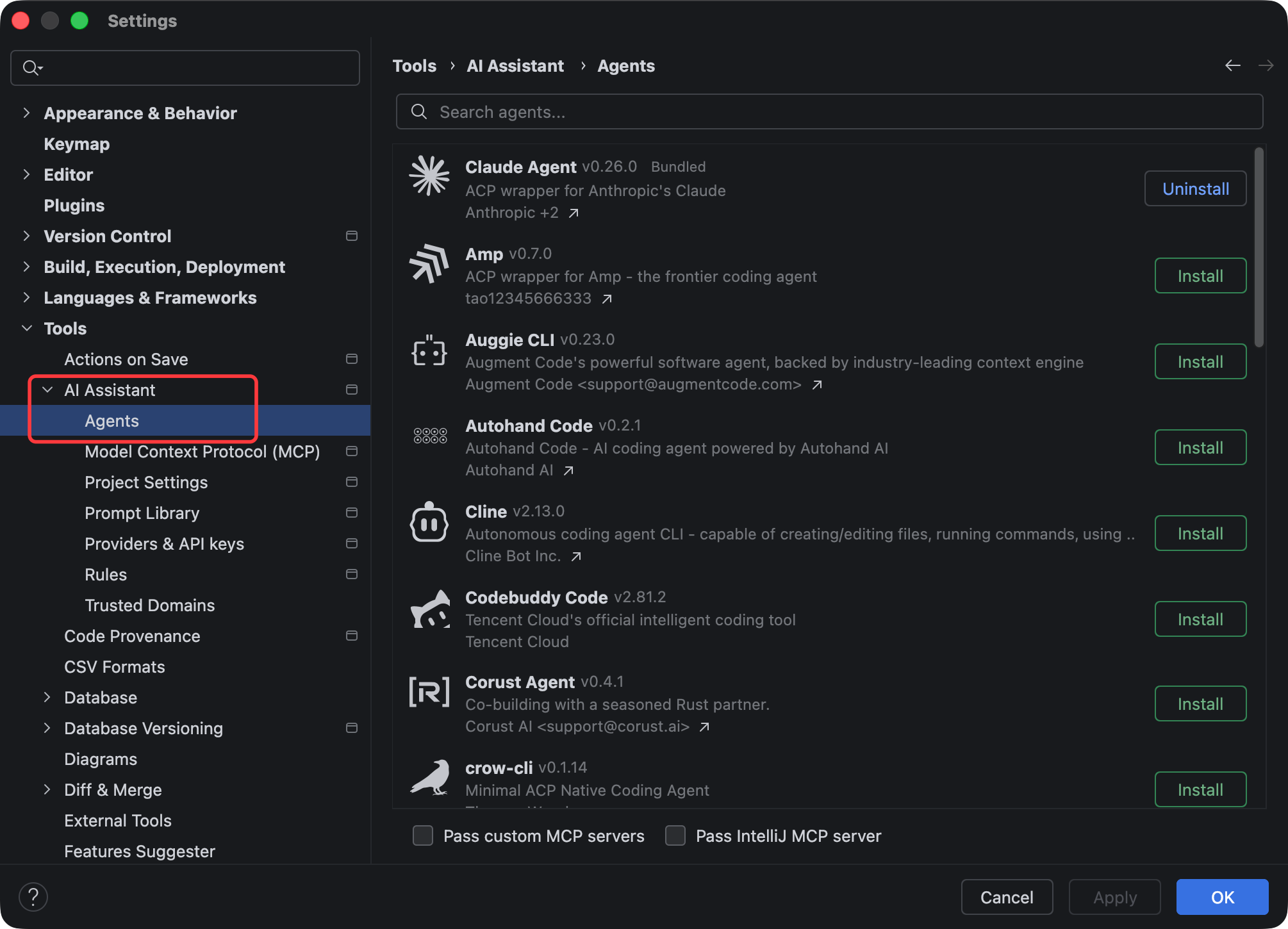

进入 IDEA 的 Settings – Tools – AI Assistant – Agents 界面:

在这个界面,扫完并安装自己喜欢的 AI 编程助手插件即可。

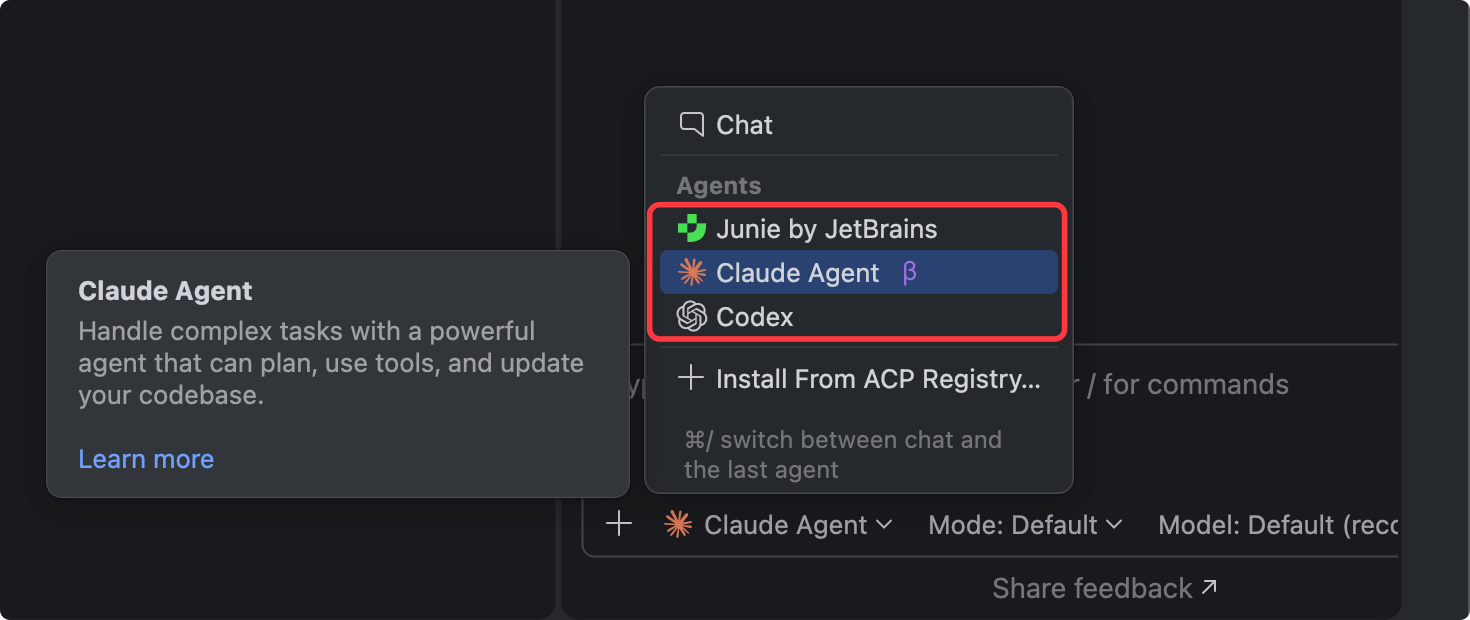

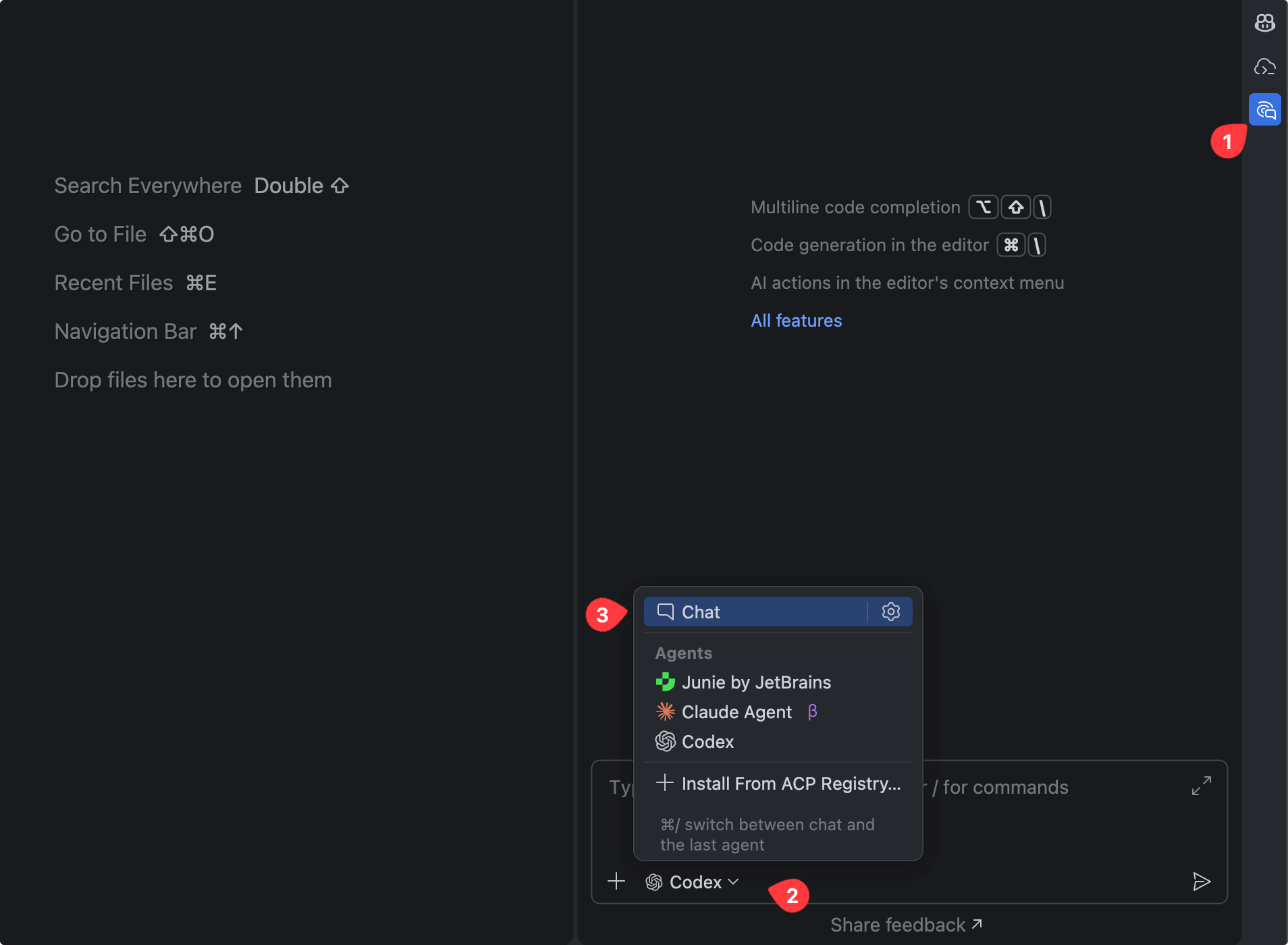

安装完成之后,在 AI Chat 面板中选择要使用的 Agent:

在这里还可以切换不同的模型,然后和正常的 AI 编程助手一样的方式进行提问。

接入更多 AI 供应商

接入第三方 AI 供应商

如果你有大模型的 API 地址,或者是本地模型,也可以通过 IDEA 的接口接入到 IDEA 中。

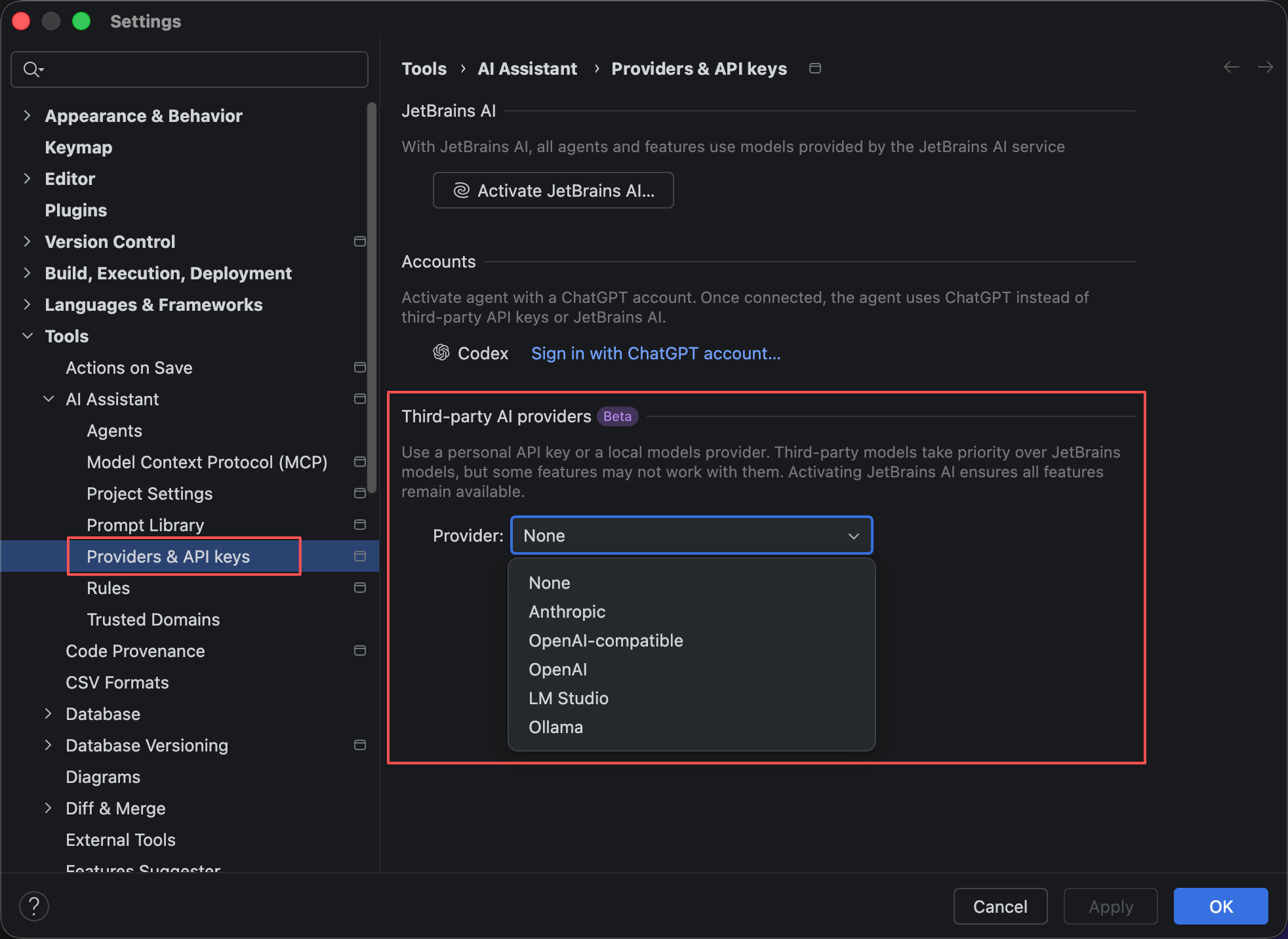

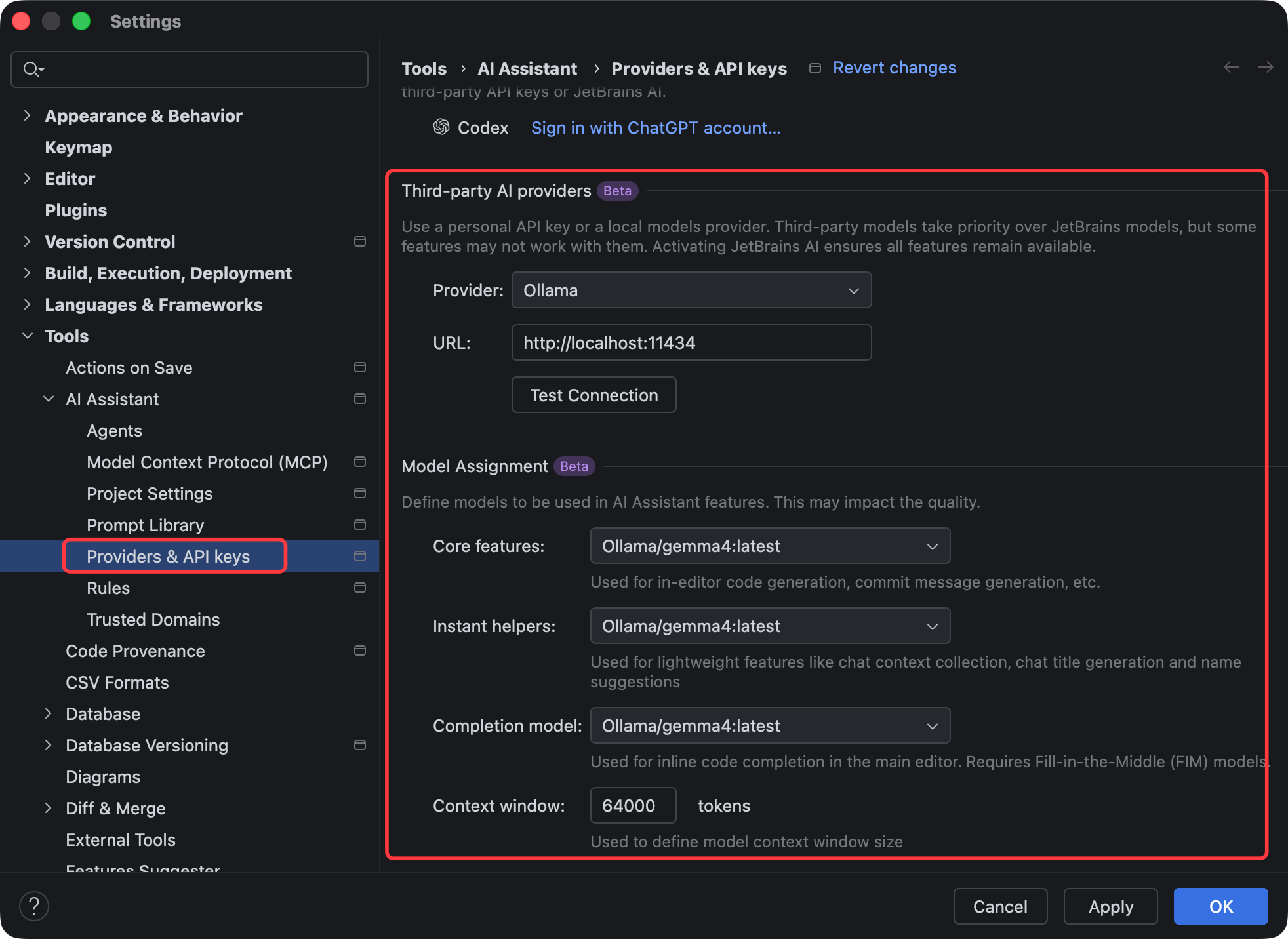

进入 IDEA 的 Settings – Tools – AI Assistant – Providers & API keys 界面:

在这里可以选择一些第三方的 AI 提供商,比如:Anthropic、OpenAI,或者选择 OpenAI 兼容的 API 来接入自己的模型,或者选择 Ollama 接入自己的本地模型。

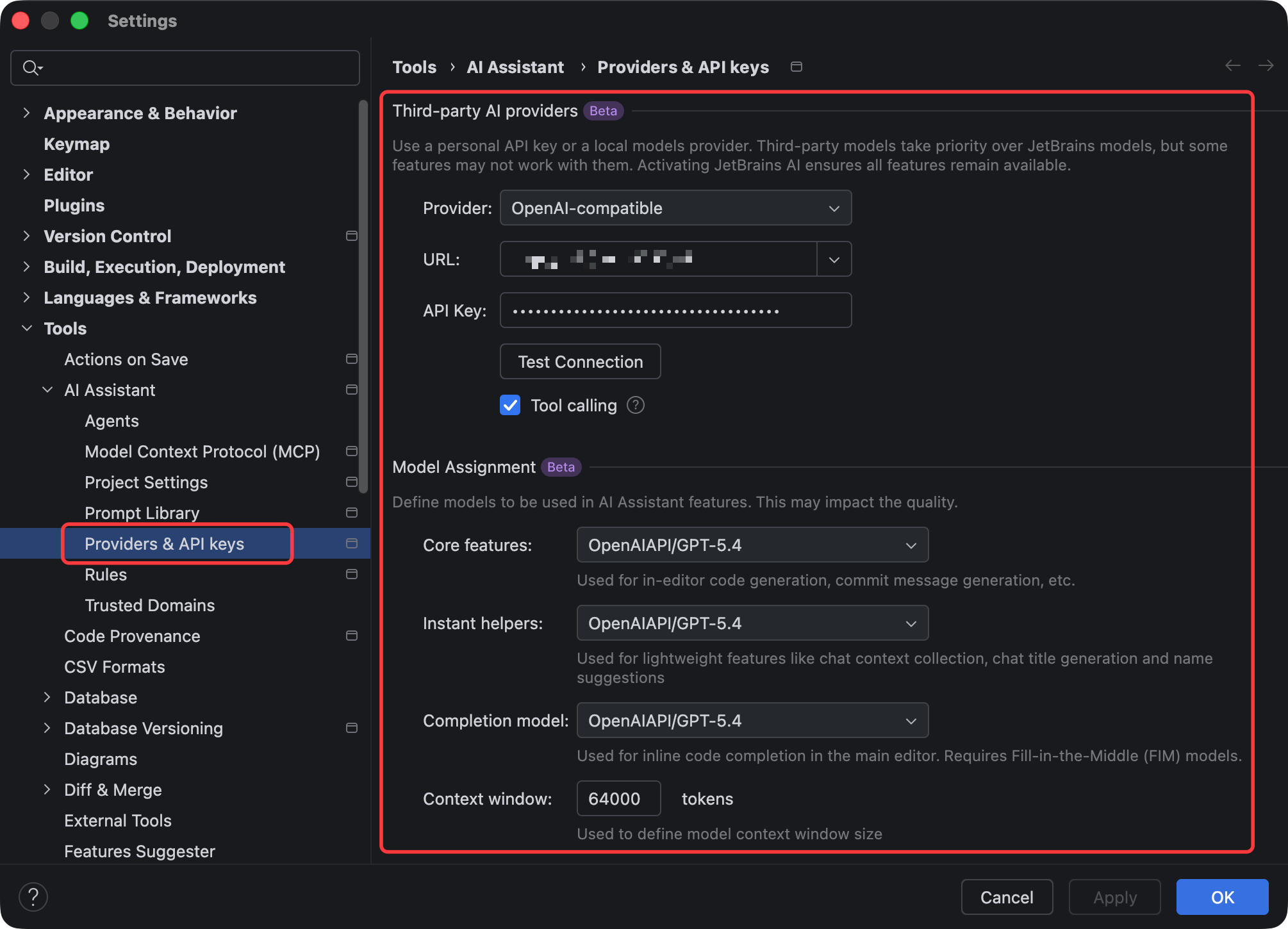

OpenAI 兼容接口配置示例:

比如,我上图选择了 OpenAI 兼容的 API 接口,填入 API 的 URL 和 Key 就可以了。

使用 OpenAI 兼容的 API 接口 的好处就是,可以对多个 Codex 账号进行反向代理,只需要配置一个 API URL 即可,后端可以根据账户额度自由切换,也就是中转站(账号池)的思路。

接入 AI 本地模型

如果你有部署自己的本地模型,也可以通过 IDEA 的接口接入到 IDEA 中。

在 IDEA 中,接入本地模型是通过 Ollama 来实现的,Ollama 是一个开源的本地大模型部署工具,支持在本地部署各种大模型,并提供 API 接口。

具体如下图所示,选择 Ollama,填入本地模型的名称和 API 地址即可:

接入本地模型的好处是,不仅可以保证数据的安全性和隐私性,不用担心数据泄露的问题,还可以根据自己的需求进行模型的定制和优化,提升模型的性能和效果。

前提是,本地设备需要有合适的算力和内存配置,要能够支持满血大模型的运行。

注意:如果登录了 Codex 账户,那么 Codex 账户的优先级要高于 API。所以,如果要使用 API,退出 Codex 的账户就行。

使用方式

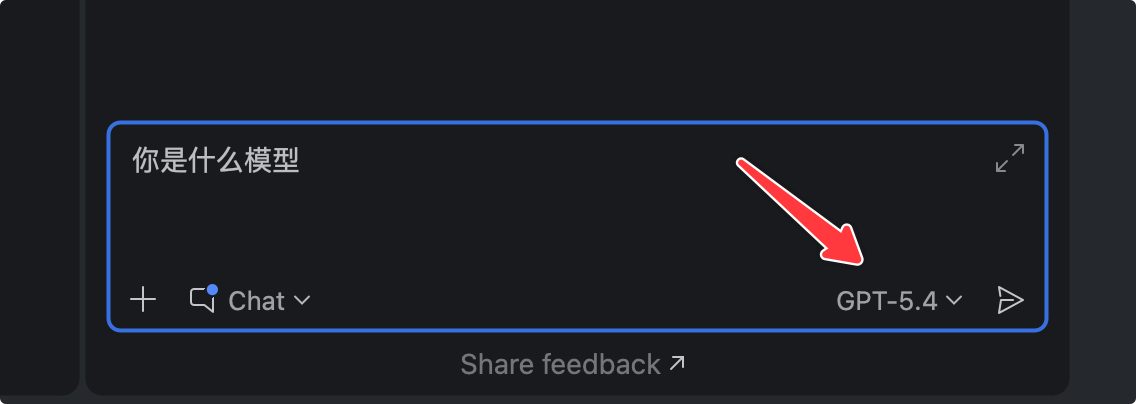

使用方式和之前一样,只不过使用 API 就要选择 Chat 模式:

然后右下角可以选择 API 提供商的模型:

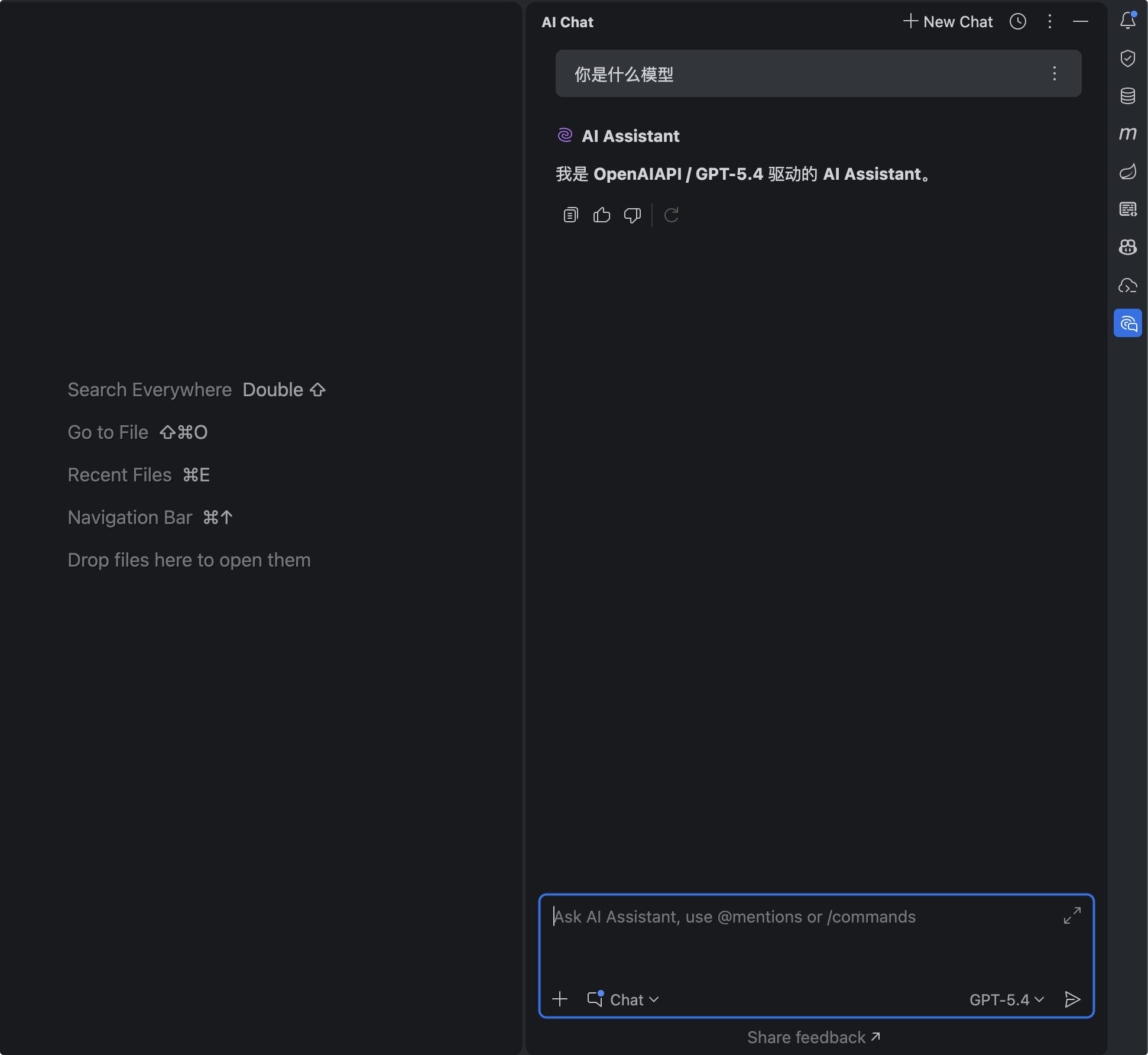

测试一下使用 API 的效果:

输出和预期的一致,说明 API 接入成功了。

总结一下,IDEA 的 AI 编程助手接口非常方便,不仅可以接入各种第三方的 AI 插件,还可以接入自己的 API 模型,基本国内外的主流 AI 编程助手和大模型都支持,非常灵活。

现在的 IDEA 已经全面拥抱 AI 了,看看这篇:

IDEA 的春天又来了,大家快去试试吧!

开发 Java,还得是 IntelliJ IDEA!!

声明:本站所有文章,如无特殊说明或标注,均为本站原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。